开云体育官方网站 翻完DeepSeek敷陈, 咱们发现了中国AI的贯通

裁剪|冷猫、+0

这两天,群众顶级大模子接连更新,重磅讯息一个接一个。

中国这边也迎来打扰不凡的一周,从周一运行,Qwen、Kimi、小米、腾讯接踵发布最新模子。周五,千呼万唤的 DeepSeek 终于发布 V4 双版块,激发了国内 AI 圈的一波海啸。

其中,中国迈入万亿参数俱乐部并已开源的模子有 DeepSeek 和 Kimi 两家,小米也预报了将会开源最新的万亿模子。

翻完 DeepSeek V4 近 60 页的技能敷陈,咱们发现这两个已开源万亿模子之间的贯通,比任何单打独斗都可怕。

再往前溯源的话,咱们发现 DeepSeek 和 Kimi 如故是第 N 次「偶遇」了。这可动力于梁文锋和杨植麟对 Scaling Law 的共同信仰和对 AGI 的竞逐。

屡次偶遇背后的一场「协谋」

从 DeepSeek-R1 和 Kimi K1.5 仅隔两小时发布,DeepSeek-NSA 与 Kimi MoBA 论文同期发表、Kimi 数学推理模子 Kimina-Prover 启发 DeepSeek-Prover V2,到如今的 Kimi K2.6 与 DeepSeek-V4 在袪除周发布,都头并进。

这两家公司不是在彼此拼杀,而是在用一种近乎「开源分享」的面容,一齐朝上。

援用车圈的一句话说,「好的想象老是心有灵犀」。

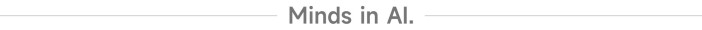

从 Kimi K2 遴荐 DeepSeek V3 的 MLA 注眼力机制,到 DeepSeek V4 引入了 Kimi 大鸿沟考据的 Muon 优化器,不错说,技能上的联动,成为了行业的一个亮点。

MLA 注眼力机制:DeepSeek 革命,Kimi 复用

最初要提到的是,DeepSeek 在 V3 中草创了 MLA 注眼力机制,这个想象通过低秩压缩技能有用减少了显存占用,从而让长险峻文推理变得可能。这个革命很快被行业宽广招供,Kimi K2 在我方的注眼力机制中也遴荐了 MLA 注眼力机制。

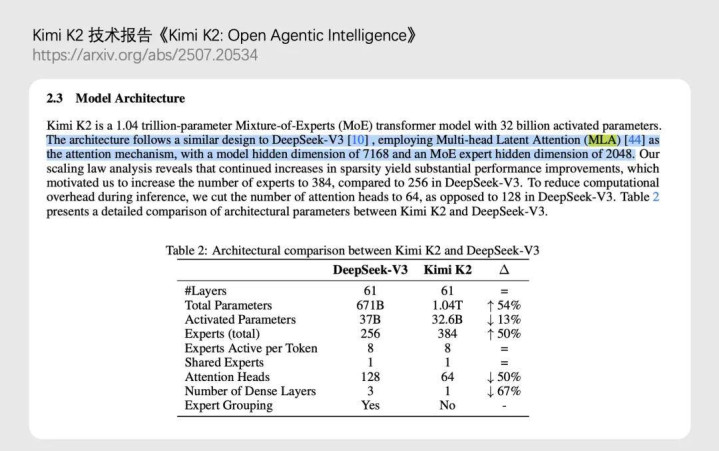

二阶优化器:Kimi 大鸿沟考据,DeepSeek 跟进

除了注眼力机制,另一个备受热心的突破是优化器技能。2025年2月,Kimi 发表《Muon is Scalable for LLM Training》论文,在 480 亿参数的 Moonlight 系列模子上考据了 Muon 优化器的恶果,用来取代如故用了 10年 的行业步履技能 Adam。2025 年 7 月,在万亿参数 Kimi K2 中,二阶优化器 Muon 被初度大鸿沟专揽,展示了其在大鸿沟说话模子覆按中的上风。

如今,DeepSeek V4 也跟进用 Muon 优化器技能,收尾覆按遵守的稳妥性。两家公司将底层的优化技能彼此吸纳,冲破了技能壁垒,展现出前所未有的深度配合。

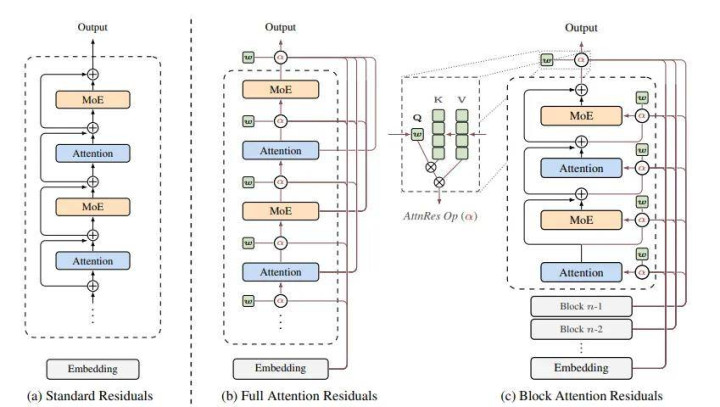

残差持续:两种不同的处分决议

说到残差持续,DeepSeek 和 Kimi 也各有突破。

DeepSeek 在 V4 中引入了 mHC 残差持续,见识亦然提高信息传递的遵守。通过蜕变多头注眼力的拼接面容,mHC 提高了梯度流动的遵守,实测覆按遵守提高了约 30%。

Kimi 建议的 Attention Residuals(注眼力残差)优化了信息流的传递遵守,擢升了模子的阐述。这一革命得到了宽广的招供,Andrej Karpathy 点评称「咱们对《Attention is All You Need》的泄露还不够」,OpenAI 推理之父 Jerry Tworek 点评称「咱们应该再行念念考一切,深度学习的2.0期间正在到来」,马斯克也在酬酢媒体上为此点赞,称是「令东谈主印象潜入的盘考」。

这两种决议各有秉性,展现了两家公司在袪除技能问题上不同的念念路。

长险峻文推理:两种技能阶梯的探索

长险峻文推理是 AI 模子的一大挑战,Kimi 和 DeepSeek 在这少量上的念念路也各不调换。Kimi 在 2024 年收尾了百万 Token 险峻文的智商,尽管这一智商十分宽广,但老本问题依然很大,超长险峻文的想象支拨呈现出线性增长,普通建设者很难承受。

到了 2026 年,DeepSeek 和 Kimi 永诀建议了两种处分决议:

DeepSeek 弃取了疏淡注眼力,开云app下载通过让模子只热心输入中的要道部分,缩短想象量,从而让百万险峻文的老本变得更可接收。这种方法诚然唐突精确聚焦要道信息,但想象和调优难度较大。

Kimi 则推出了线性注眼力架构,蜕变了注眼力机制的想象面容,使得想象复杂度从 O(n²) 降到 O(n),从表面上大幅缩短了长险峻文的想象老本。

这两种决议相通各有上风,疏淡注眼力强调精确性,线性注眼力则追求高效性。更垂危的是,Kimi 和 DeepSeek 同期在这两条技能阶梯上都在发力,为将来的长险峻文推理提供了多种弃取。

从「两个公司」到「一套基础设施」

DeepSeek 和 Kimi 的「偶遇」故事不仅仅技能圈的打扰,亦然关乎中国 AI 产业花式的一件大事。

GPT-4 的参数目于今未发达公布(外界猜测在 1.8T 支配),Claude 3.5 Opus 相通闭源。而中国的这两家创业公司,不仅作念出了同等鸿沟的模子,还弃取了全部开源。这意味着任何建设者、任何盘考机构、任何企业,都不错免费获得这些模子进行二次建设和部署。

径直的收尾是:企业专有化部署的老本砍到了本来的 1/10。中小企业终于能在我方的事业器上跑万亿参数级别的模子了,这事儿放在一年前,想都不敢想。

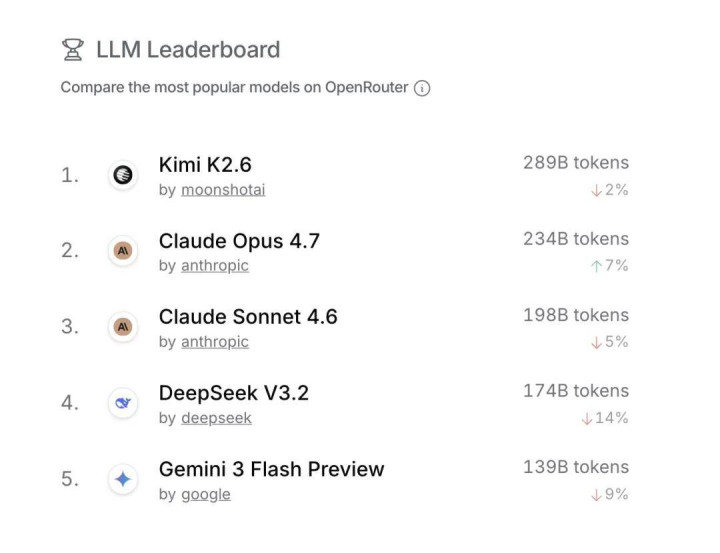

生态这块也在偷偷成形,在 OpenRouter 平台上,两者的 API 调用量稳居中国前两名;在专揽层,Kimi 被国外爆款编程用具「套壳」接入,而 DeepSeek 则被日本乐天集团径直包装成了 Rakuten AI 3.0。

就连硅谷的巨头们,也不得不正视这股来自东方的力量。

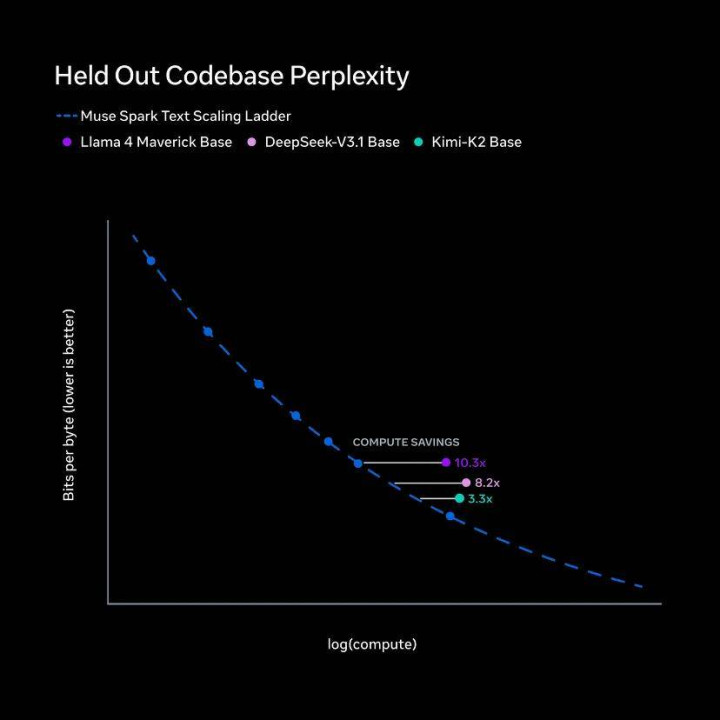

在 Meta 最新模子 Muse Spark 发布的官方技能博客中,Llama 4 被径直拿来与 DeepSeek-V3.1 以及 Kimi-K2 进行性能对比:

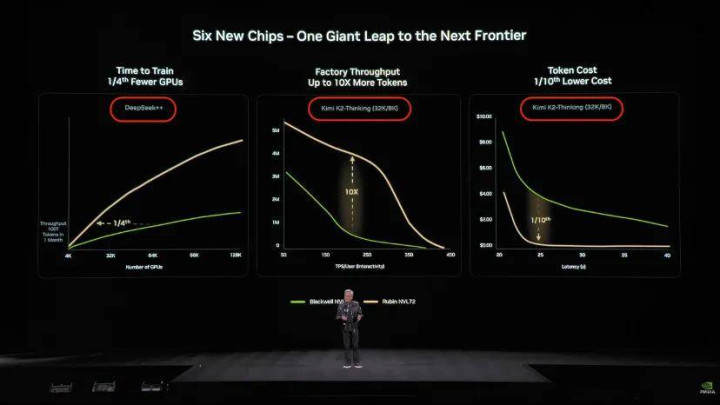

而在黄仁勋的CES主题演讲上,黄仁勋更是将 DeepSeek 和 Kimi K2-Thinking 模子光显放上大屏幕,看成展示其下一代 Blackwell 与 Rubin 芯片宽广性能的 Benchmark 标杆:

与此同期,两家公司都在国产芯片适配上作念出了本体性插足。

DeepSeek V4 初度深度适配华为昇腾芯片,推理设施将运行在国产硬件上;Kimi 的 Prefill-as-a-Service 决议则建议了跨数据中心异构硬件推理框架,允许用不同类型的国产芯片永诀承担 Prefill 和 Decode 阶段,实测朦拢量擢升 54%,首 token 延长缩短 64%。这为国产芯片进入大模子推理链条大开了一个现实的切进口。

黄仁勋在播客节目中说了一句言不尽意的话:「芯片又不是铀浓缩,抵触不了中国芯片的朝上,他们依旧不错通过国产芯片来建设模子。」

他可能没猜度,DeepSeek 和 Kimi 正在用现实行动让这一天来得这样早,这样快。

结语:两个广东东谈主,撑起中国 AI 的半边天

技能的高度,最终取决于东谈主的花式。

2023 年同庚起步,用最短时候双双叩开百亿好意思金十角兽大门——DeepSeek 与 Kimi,弥远保执着业内东谈主数最精简、但东谈主才密度最顶尖的成立。两位相通来自广东的首创东谈主,杨植麟与梁文锋,既是技能的狂热信徒,亦然被交付厚望的中国 AI 国度队。

在总理主执召开的经济场面群众和企业家茶话会上,两东谈主时隔一年永诀建言献计,成为了中国 AI 发展史上的一个有劲注脚。他们都是技能范式的引颈者:DeepSeek 向天下评释了「念念维链」的威力,而 Kimi 则在国内引颈了「智能体」的落地怒潮。

在追赶 AGI 的这场马拉松里,莫得哪一家公司不错闭门觅句地跑都备程。DeepSeek 与 Kimi 之间,有竞争,也有共识——Muon 与 MLA 的技能互通,底层机制上惺惺惜惺惺的探索,刚巧证明:中国 AI 确凿的底气,从来不是某一家公司的单打独斗,而是这种在「偶遇」中碰撞出的技能火花,以及在开源生态里悄然滋长的互利共生。

双峰并峙开云体育官方网站,终将顶峰相遇。属于中国大模子的万亿级帆海期间,才刚刚拉开序幕。

开云体育官方网站 - KAIYUN